- 一、celery介绍

- 二、Celery执行异步任务

- 三、celery执行多异步任务

- 四、celery执行定时任务

- 五、Django的celery异步任务

- 1.安装注册

- 2.settings.py末尾配置

- 3.创建一个子应用

- 4.在项目主目录中创建一个文件(celery.py) , 用来编写celery的控制文件

- 5.编写任务文件 tasks.py,创建第一个任务

- 6.创建带参数的任务

1.定义

在web开发中,要给用户发送邮件,发送短息,都属于耗时的操作,会导致给用户的响应时间变长,这种情况的解决办法,给用户先返回一个响应,不要影响用户的使用,将这些耗时的操作,放在后台执行,例如新开一个进程,celery就是解决这个问题而生

2.celery组成部分

- worker:执行任务的单元,可以理解为一个一个的线程任务,并发的执行。

- broker:消息中间件 ,用来在服务和woker中传递消息。Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis等等

- backend:用来存储消息以及celery执行结果。

3.使用场景 celery是一个强大的 分布式任务队列的异步处理框架,它可以让任务的执行完全脱离主程序,甚至可以被分配到其他主机上运行。我们通常使用它来实现异步任务(async task)和定时任务(crontab)。

- 异步任务:将耗时操作任务提交给Celery去异步执行,比如发送短信/邮件、消息推送、音视频处理等等

- 定时任务:定时执行某件事情,比如每天数据统计

4.特点

- 简单:Celery 使用和维护都非常简单,并且不需要配置文件。

- 高可用:woker和client会在网络连接丢失或者失败时,自动进行重试。并且有的brokers 也支持“双主”或者“主/从”的方式实现高可用。

- 快速:单个的Celery进程每分钟可以处理百万级的任务,并且只需要毫秒级的往返延迟(使用 RabbitMQ, librabbitmq, 和优化设置时)

- 灵活:Celery几乎每个部分都可以扩展使用,自定义池实现、序列化、压缩方案、日志记录、调度器、消费者、生产者、broker传输等等。

5.安装celery组件和redis

redis安装:https://blog.csdn.net/qq_40558166/article/details/102980775 celery安装:pip install -U Celery

1.创建一个异步任务执行文件celery_task.py

import celery

import time

# 消息中间件和backend都使用redis数据库,使用1和2两个子库

backend='redis://127.0.0.1:6379/1'

broker='redis://127.0.0.1:6379/2'

cel=celery.Celery('test',backend=backend,broker=broker) #当定义了cel,下边的装饰器必须使用cel.task

@cel.task

def send_email(name):

print("向%s发送邮件..."%name)

time.sleep(5)

print("向%s发送邮件完成"%name)

return "ok"

@cel.task

def send_msg(name):

print("向%s发送消息..."%name)

time.sleep(5)

print("向%s发送消息完成"%name)

return "ok"

2.在命令行执行命令,即可看到该任务已经被监听,但是没有启动

celery worker -A celery_task -l info

3.创建执行任务文件produce_task.py

from celery_task import send_email,send_msg

result = send_email.delay("zs")

print(result.id)

result2 = send_msg.delay("ls")

print(result2.id)

4.运行produce_task.py运行,即可得到两个id值,这两个id值相当于我们backend存储的返回消息的钥匙,我们celery_task.py文件中的任务返回的值,会存在此处  5.如果我们要获取这些值,可以写个单独的文件

5.如果我们要获取这些值,可以写个单独的文件

from celery.result import AsyncResult

from celery_task import cel

async_result=AsyncResult(id="获取的id值", app=cel)

if async_result.successful():

result = async_result.get()

print(result)

# result.forget() # 将结果删除

elif async_result.failed():

print('执行失败')

elif async_result.status == 'PENDING':

print('任务等待中被执行')

elif async_result.status == 'RETRY':

print('任务异常后正在重试')

elif async_result.status == 'STARTED':

print('任务已经开始被执行')

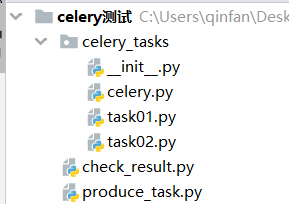

本质就是创建一个文件夹,把每个任务分开写。  各文件中的内容

各文件中的内容

celery.py

from celery import Celery

cel = Celery('celery_demo',

broker='redis://127.0.0.1:6379/1',

backend='redis://127.0.0.1:6379/2',

# 包含以下两个任务文件,去相应的py文件中找任务,对多个任务做分类

include=['celery_tasks.task01',

'celery_tasks.task02'

])

# 时区

cel.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

cel.conf.enable_utc = False

-------------------------------------------------------------------------

task01.py

import time

from celery_tasks.celery import cel

@cel.task

def send_email(res):

time.sleep(5)

return "完成向%s发送邮件任务"%res

-------------------------------------------------------------------------

task02.py

import time

from celery_tasks.celery import cel

@cel.task

def send_msg(name):

time.sleep(5)

return "完成向%s发送短信任务"%name

------------------------------------------------------------------------

produce_task.py:

from celery_tasks.task01 import send_email

from celery_tasks.task02 import send_msg

# 立即告知celery去执行test_celery任务,并传入一个参数

result = send_email.delay('yuan')

print(result.id)

result = send_msg.delay('yuan')

print(result.id)

-----------------------------------------------------------------------

check_result.py:

from celery.result import AsyncResult

from celery_tasks.celery import cel

async_result = AsyncResult(id="562834c6-e4be-46d2-908a-b102adbbf390", app=cel)

if async_result.successful():

result = async_result.get()

print(result)

# result.forget() # 将结果删除,执行完成,结果不会自动删除

# async.revoke(terminate=True) # 无论现在是什么时候,都要终止

# async.revoke(terminate=False) # 如果任务还没有开始执行呢,那么就可以终止。

elif async_result.failed():

print('执行失败')

elif async_result.status == 'PENDING':

print('任务等待中被执行')

elif async_result.status == 'RETRY':

print('任务异常后正在重试')

elif async_result.status == 'STARTED':

print('任务已经开始被执行')

设定时间让celery执行一个定时任务,produce_task.py:

from celery_task import send_email

from datetime import datetime

# 方式一

# v1 = datetime(2020, 8, 2, 16, 19, 00)

# print(v1)

# v2 = datetime.utcfromtimestamp(v1.timestamp()) #必须要使用国标时间

# print(v2)

# result = send_email.apply_async(args=["egon",], eta=v2)

# print(result.id)

# 方式二

ctime = datetime.now()

# 默认用utc时间

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

from datetime import timedelta

time_delay = timedelta(seconds=10)

task_time = utc_ctime + time_delay

# 使用apply_async并设定时间

result = send_email.apply_async(args=["egon"], eta=task_time)

print(result.id)

多任务结构中celery.py修改如下:

from datetime import timedelta

from celery import Celery

from celery.schedules import crontab

cel = Celery('tasks', broker='redis://127.0.0.1:6379/1', backend='redis://127.0.0.1:6379/2', include=[

'celery_tasks.task01',

'celery_tasks.task02',

])

cel.conf.timezone = 'Asia/Shanghai'

cel.conf.enable_utc = False

cel.conf.beat_schedule = {

# 名字随意命名

'add-every-10-seconds': {

# 执行tasks1下的test_celery函数

'task': 'celery_tasks.task01.send_email',

# 每隔2秒执行一次

# 'schedule': 1.0,

# 'schedule': crontab(minute="*/1"),

'schedule': timedelta(seconds=6),

# 传递参数

'args': ('张三',)

},

# 'add-every-12-seconds': {

# 'task': 'celery_tasks.task01.send_email',

# 每年4月11号,8点42分执行

# 'schedule': crontab(minute=42, hour=8, day_of_month=11, month_of_year=4),

# 'args': ('张三',)

# },

}

- 启动 Beat 程序$ celery beat -A proj # Celery Beat进程会读取配置文件的内容,周期性的将配置中到期需要执行的任务发送给任务队列

- 之后启动 worker 进程.$ celery -A proj worker -l info 或者$ celery -B -A proj worker -l info

和之前的开发相比,django-celery只是将任务发布出去,处理耗时操作发送邮件,发送短信 ,爬虫,使用异步任务去实现,使得主进程不会阻塞,web服务只负责发起任务和接受任务的结果,中间执行的过程交给异步任务处理。

1.安装注册pip install django-celery

pip install django-redis

pip install redis

import djcelery # 导入包

djcelery.setup_loader() # 进行模块载入

BROKER_URL = 'redis://127.0.0.1:6379/1' # 中间件,使用下标为1的数据库

BACKEND_URL = 'redis://127.0.0.1:6379/1'

CELERY_IMPORTS = ('CeleryTask.tasks',) # 具体的任务文件

CELERY_TIMEZONE = 'Asia/Shanghai' # celery时区,跟Django保持一致

CELERYBEAT_SCHEDULER = 'djcelery.schedulers.DatabaseScheduler' # Django-celery的处理器,是固定的

命令行输入

python manage.py CeleryTask

并在配置文件中创建task.py文件,应用名称叫什么不重要,但是里边的tasks.py文件名字必须不能改

celery.py

celery.py

import os

from celery import Celery

from django.conf import settings

#设置celery的环境变量和Django-celery的主目录

os.environ.setdefault('DJANGO_SETTINGS_MODULE','CeleryTask.settings')

#实例化一个celery应用,art_project celery服务器的名字

app=Celery('art_project')

#加载celery的配置

app.config_from_object('django.conf:settings')

#如果在项目当中,创建了task.py,celery就会沿着app去寻找这个文件来生成任务

app.autodiscover_tasks(lambda :settings.INSTALLED_APPS)

①创建任务  ②数据迁移

②数据迁移

python manage.py migrate

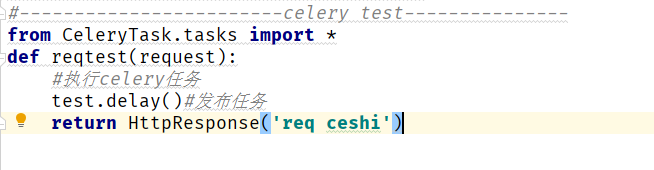

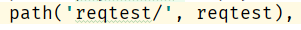

③配置视图和路由  路由

路由  ④启动celery

④启动celery

python manage.py celery worker --loglevel=info

在视图中写函数

在视图中写函数  启动celery

启动celery

python manage.py celery worker --loglevel=info