标题:SLAM++: Simultaneous Localisation and Mapping at the Level of Objects

作者;Renato F. Salas-Moreno, Richard A. Newcombe, Hauke Strasdat, Paul H.J. Kelly, Andrew J. Davison

来源:CVPR 2013

摘要

大家好,今天为大家带来的文章是——SLAM++:面向对象的同时定位与建图系统,该文章发表于Proceedings of the IEEE conference on computer vision and pattern recognition. 2013.

作者中 Andrew J. Davison是大名鼎鼎的单目SLAM(MonoSLAM: Real-Time Single Camera SLAM)的作者。他现在是Professor, Department of Computing, Imperial College London, 研究方向是vision and AI technology for next generation home robotics.

现在的SLAM系统大多数操作于低级别的原语(点,线,贴片或像深度图一样的非参数化的表示),必须进行鲁棒匹配,几何变换和优化,以便地图代表复杂性现实世界。

本文展示了一种新的“面向对象的”3D SLAM范例,它能在算法循环中充分利用由许多重复的,特定的对象和结构组成的场景中的先验知识。当手持式深度相机拓展杂乱的场景时,为实时3D物体识别和跟踪提供了六自由度的相机-对象模型约束,这些约束提供给对象图,并通过有效的位姿-图优化算法可使其更加精致。SLAM系统可以进行深度表面重建,这展示了SLAM系统的巨大的描述和预测能力,但也伴随着巨大的表示压缩的的缺点。该对象-图模型可以实时的对每一帧,基于ICP的相机-对象模型的精确预测并跟踪,并在当前所识别的图像区域中有效的对新的对象进行动态搜索。我们在大型杂乱的环境中展示了一个实时增量的SLAM系统,它包括闭环检测,重定位和移动物体的检测,并可以生成具有交互潜力的对象级别的场景描述。

介绍本文提出了一个纯面向对象级别的SLAM系统(A Pure Oboject-Level SLAM System)。描述了一个实时递增的SLAM(real time incremental SLAM)。它具有如下特点:

- 1. 适用于大规模复杂环境,场景中包含重复、预先设定的物体与结构

- 2. 可以进行重定位与回环检测

- 3. 运动物体检测

- 4. 生成对象级别的场景描述, 增强了交互的可能性

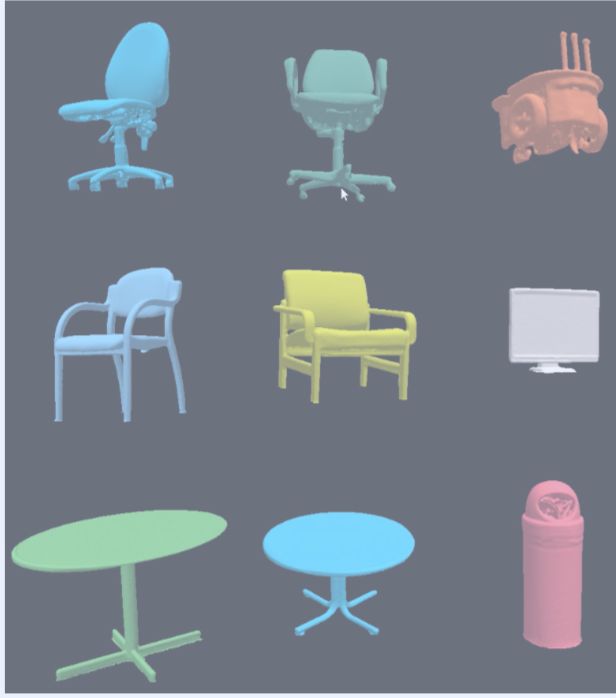

在对一个特定场景进行实时操作之前,本文使用KinectFusion通过交互式扫描为重复出现的物体快速制作出高质量的3D模型,如图1所示。

图 1. 对象数据库

2. SLAM++算法架构

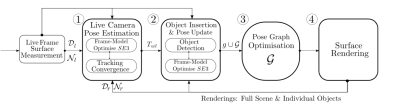

图 2. SLAM++流程架构

SLAM++算法架构如图2所示。给定一个深度图Dl,我们首先通过以顶点和法线图Nl的形式来进行表面测量(Surface measurement). 它将作为后续相机识别和目标物体检测的输入。

(1)本文使用Iterative closest point (ICP)算法在当前的SLAM图G中实时跟踪相机位姿Twl.

(2) 接下来我们尝试在场景中 检测先前存储在数据库中的目标物体,从而生成能在场景中估计位姿的候选物体。使用检测到的位姿初始化第二个ICP预测,并通过它对先前的候选对象进行精炼或剔除。

(3)我们添加成功检测到的目标对象g到SLAM图中。物体-位姿顶点与实时估计的相机-位姿顶点通过一条测量边连接到一起。

(4)从SLAM图中渲染对象,将预测深度Dr和法线图Nr生成到实时估计帧中,使我们能够主动搜索图中当前对象未描述的那些像素。我们在每个对象和实时图像之间运行单独的ICP,从而在SLAM图中添加新的相机对象约束。

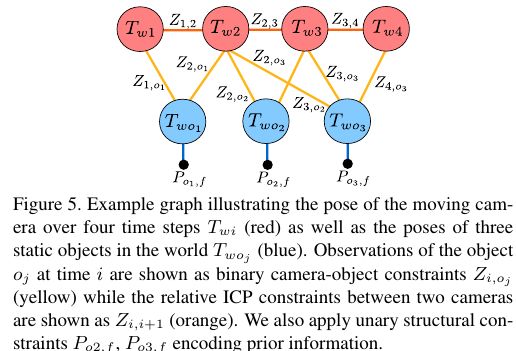

图 3. 图优化

3. 图优化图3.描述了摄像机移动时在四个时间步长Twi(红色)上的位姿以及世界中三个静态物体的位势Twoj(蓝色)。在时间i处对象oj的观察被示为二元相机-对象约束Z(i,oj)(黄色),而两个相机之间的相对ICP约束被表示为Z(i,i + 1)(橙色)。我们还用一元结构约束P(o2,f),P(o3,f)编码先验信息。

我们展示了一个新级别的实时重定位与建图性能,我们在之前注重质量和密度几何表示的SLAM系统的基础上前进了一小步。并且在目标对象识别和配置描述方面可与离线多视图场景标记系统相媲美。

主要包括以下功能:

(1) 大规模场景建图

(2) 运动物体检测

(3) 使用物体对象进行增强现实

(4) 回环检测

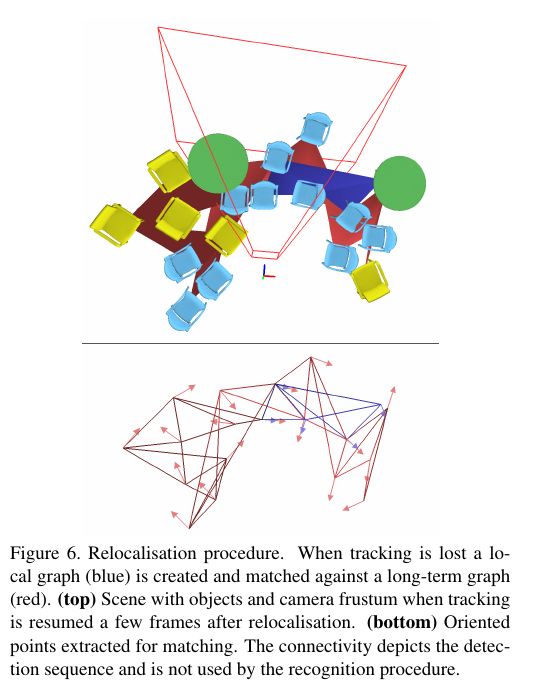

图 4. 重定位

图4描述了重定位过程,当跟踪丢失时,将创建本地图(蓝色)并与长期图(红色)进行匹配。(顶图)在重新定位后几帧恢复跟踪时,带有对象和相机平截头体的场景。(下图)提取有定向特征点用于匹配。连通性描述了检测序列,并且不被识别过程使用。

图 5. 回路检测

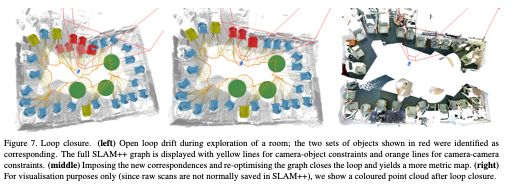

图5是闭环检测。(左图)探索房间时的开环漂移,红色标识的两组物体是相对应的。完整的SLAM++中黄色的线条是相机-物体约束,橙色线条是用于相机-相机约束。(中图)加强新的对应关系并重新优化图形关闭循环并产生更好的度量图。(右图)仅用于可视化目的,我们在循环闭合后显示彩色点云。

图 6. 增强现实

图6描述了上下文感知增强现实:虚拟角色在已建图的地图上进行移动并自动查找坐位。