欢迎点击「算法与编程之美」↑关注我们!

本文首发于微信公众号:"算法与编程之美",欢迎关注,及时了解更多此系列文章。

Python在用于爬虫时,在许多的关于爬虫的教程中,重点介绍并使用的是一个HTTP客户端库,requests库。然而,本篇文章介绍的是另外一个用来数据抓取的库,urllib库。

关于urllib库,的确是一个很尴尬的库。它在Python不同版本中有很明显的区别,还有在实际的开发应用中,最头痛的就是版本之间互不兼容的问题。由于Python 3更加的健全稳定,因此,本文中所谈的urllib针对的是Python 3。作为Python自带的一个标准库,它不需要安装,在使用时,直接导入即可。urllib是一个通过几个模块来使用URL的软件包。它主要有以下几个功能:

-

urllib.request:用于打开和读取URL。

-

urllib.error:包含提取例外的urllib.request。

-

urllib.parse:用于解析URL。

-

urllib.robotparse:用于解析robots.txt文件。

在爬虫时,urllib的语法为:

Urllib.requests.urlopen(url,data=None,[timeout,]*,cafile=None,capath=None,cadefault=False,context=None)

接下来,我们谈谈其中一个比较重要的参数含义:data的参数主要用来确定请求方式,当参数值为None时,请求方式为get,反之为post。在urlopen获取网站响应数据时,有几组函数来获取响应数据的内容。比较常用的是read()函数。

我们来看看简单的示例,更好的感受urllib模块在爬虫中的应用。

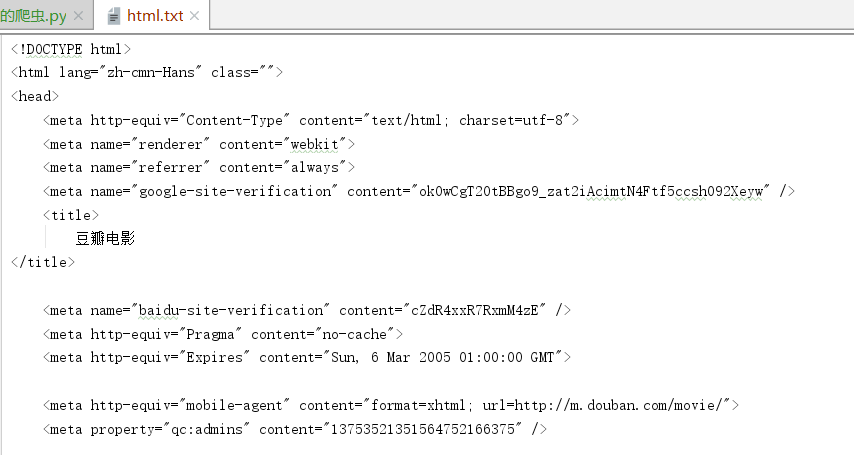

import urllib.request

response = urllib.request.urlopen('https://movie.douban.com/',None,2)

html = response.read().decode('utf8')

f = open('html.txt','w',encoding='utf8')

f.write(html)

f.close()

在进行数据抓取的时候,往往会遇见反爬的情况,这个时候,我们就需要合理的编写程序去克服这些困难。

拓展阅读:

where2go 团队

微信号:算法与编程之美

长按识别二维码关注我们!

温馨提示:点击页面右下角“写留言”发表评论,期待您的参与!期待您的转发!