点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

作者丨图灵智库

来源丨 泡泡机器人SLAM

编辑丨3D视觉工坊

标题: Learning Temporal Consistency for Low Light Video Enhancement from Single Images

作者:Fan Zhang ,Yu Li ,Shaodi You, Ying Fu *

机构:Beijing Institute of Technology, Applied Research Center (ARC), Tencent PCG

University of Amsterdam

来源:CVPR 2021

编译:Cristin

审核: ZH

摘要

大家好,今天为大家带来的文章是 Mix3D: Out-of-Context Data Augmentation for 3D Scenes

单幅图像弱光增强是一项重要的任务,它有许多实际应用。大多数现有的方法采用单图像方法。虽然它们在静态单幅图像上的性能令人满意,但我们发现,在处理微光视频时,它们会遭受严重的时间不稳定性。我们注意到问题是因为现有的数据驱动方法是从没有时间信息的单个图像对中训练的。不幸的是,从实时一致性数据进行训练也存在问题,因为在受控环境下,不可能大规模、多样地收集具有相同统计噪声的像素明智配对的低光和正常光视频。在本文中,我们提出了一种新的方法,以加强时间稳定性在微光视频增强只有静态图像。其关键思想是从单个图像中学习和推断运动场(光流),并合成短距离视频序列。我们的策略是通用的,可以直接扩展到大规模数据集。基于这一思想,我们提出了一种能够推断运动先验的单幅图像微光视频增强方法,并增强了时间一致性。严格的实验和用户研究证明了我们提出的方法的最先进的性能。我们的代码和模型将在

主要工作与贡献

本文的主要贡献总结如下:

•我们提出了一种新的解决方案,以解决仅使用单个图像数据时,弱光视频增强的时间不一致性问题。

•我们建议在指示单个图像的潜在运动之前使用光流,从而使我们能够建模时间一致性。

•我们通过严格的实验和用户研究证明了我们方法的最先进性能。

算法流程

我们提出了一种通过基于图像的方法实现微光视频增强的新方法,并通过稳定网络来解决闪烁问题。更具体地说,我们利用光流来表示动态场景的视频帧之间发生的运动。我们通过相应的光流扭曲图像的相邻帧来模拟它们。给定原始图像和扭曲图像的图像对,我们以暹罗式的方式训练我们的网络,将它们一个接一个地输入网络。通过在输出对之间施加一致性,我们可以帮助网络在时间上保持稳定。我们关注无噪声和有噪声两种情况,并在真实噪声数据上测试我们的模型,以显示我们网络的鲁棒性和灵活性。

图2我们的完整框架概述,包括两个步骤。(a) 光流预测。我们首先利用实例分割[31]将对象与背景分离,并在每个对象区域上随机采样10个引导运动矢量。通过将明亮的图像和矢量输入光流预测网络[32],我们可以改变方向和大小以获得不同的光流。此预测步骤可在训练前离线计算。(b) 训练和测试。我们的方法由两个分支组成,其中上一个分支在训练和测试阶段都起作用,而另一个分支仅在训练期间起辅助作用,以在网络上施加时间一致性。第二分支中的图像从具有相同光流的主分支中的图像扭曲。在推理阶段,我们的网络直接获取输入并预测输出。

1.方法概括

理想的时间稳定模型应该是变换不变的。换句话说,模型应该通过相同的转换获得转换输入的输出,就像操作直接应用于输出一样。只有这样的模型才能逐帧处理视频,而不会出现闪烁问题。基于这个假设,我们尝试用光流产生运动来模拟实际的视频序列。通过将这些图像对送入网络,并在扭曲前后加强输出的一致性,我们可以帮助网络学习时间稳定性。如图1所示,在训练网络之前,我们首先从照明良好的地面真相预测可能的光流。我们利用开源工具包Detectron2[31]中的预训练实例分割模型,将对象区域与通常发生局部运动的背景分离。给定估计的目标掩模,使用称为CMP的无监督模型很容易获得光流预测。

光流和从相邻地面真实视频帧估计的真实光流的全局变换,其中我们的预测是实例,更接近真实情况。准备好必要的光流后,我们以连体的方式训练基于图像的模型。管道的上部是网络的第一个通道,与常规培训程序相同。来自训练数据集的微光图像x1被送入网络g(·),它预测增强结果g(x1)。该网络在相应照明良好的地面真值y 1的监督下学习恢复正常光图像。为了提供更多的时间信息,我们使用随机光流f对输入图像x1进行扭曲,该随机光流f是基于地面真值预测的。扭曲图像x2用作第二遍的输入。还将输出g(x2)与相应的翘曲地面真值y2进行比较,以进行监督。最后,输出g(x1)以相同的光流f翘曲到wg(x1),f,并与输出g(x2)进行比较。之前的工作[3,4,9]已经收集了他们的微光数据集,并简单地在他们的数据上训练一个U-Net[24]。在这里,我们也选择这个简单但有效的模型来验证我们方法的有效性,并遵循SID[4]中的实现。

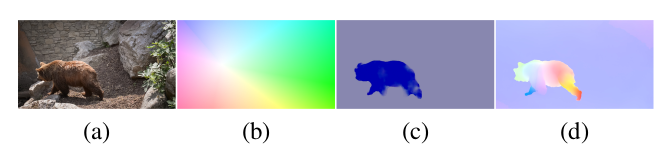

图2 光流结果示例。(a) 普通光视频帧。(b) 来自全局仿射变换的光流。(c) 通过我们的实例感知光流模拟进行光流预测。(d) 从相邻的正常光视频帧估计光流。预测的光流是实例感知的,并且比全局变换更接近相邻视频帧之间的真实光流。

1.1 光流估计

我们选择光流来代替全局仿射变换来表示运动,因为它能够同时表示全局和局部运动。因此,我们首先需要获得图像的预测光流。与大多数专注于估计两幅不同图像光流的光流方法不同,我们尝试从单个图像预测随机光流。具体而言,采用条件运动传播网络(CMP。我们利用它的预训练模型来预测GT的合理光流。在生成步骤中,需要使用对象上的一些引导运动矢量对其进行初始化,我们使用实例分割来帮助获得这些矢量。

我们为图像中的每个对象随机抽取10个向量,以获得最终预测。请注意,随机采样的引导向量无法确保预测光流的质量,但我们相信光流预测中的失败也可以通过引入干扰来帮助训练。预测的光流作为初始起点,通过增强生成各种光流情况。

1.2 低光照图像合成

为了研究我们的方法的有效性,我们需要将我们的模型与基于图像和基于视频的方法进行比较,但是微光视频数据集很少。在本文中,我们选择DAVIS数据集[23]作为我们的地面真实数据。它是一个用于视频分割任务的大规模数据集。我们排除了照明不良的视频,并合成了弱光视频。

DAVIS[23]包含两种分辨率,全分辨率和480P。我们使用所有全分辨率视频,包括2017年挑战赛和2019年挑战赛的培训集、测试和验证集。在排除照明不良的视频后,我们保留了所有分辨率为1920×1080的视频,共获得107个视频,包含7179帧。我们将这些视频随机分为训练集和测试集,训练集中有87个视频,测试集中有20个视频。对相应的光流应用相同的图像增强。然后对它们进行独立增强,以获得各种可能的光流。它们随机旋转2度、随机翻转和随机旋转全局偏移在水平方向或垂直方向或两者中添加。

1.3 噪声

噪音是我们想处理的另一件事。除了光流预测和微光图像生成外,我们还使用高斯和泊松噪声进行噪声模拟。我们相信,我们的管道是稳健的,可以应用于真实的噪声图像。噪声采样可以描述为:

实验结果

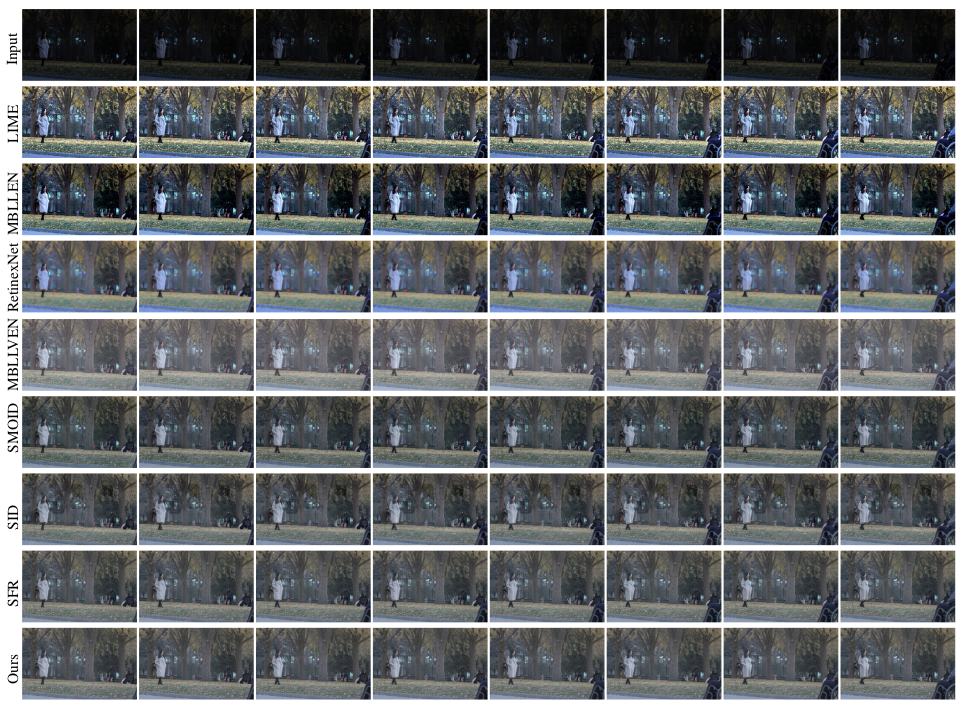

图3 我们的方法在伪影方面比基线要干净得多,并且与基于视频的方法相当。

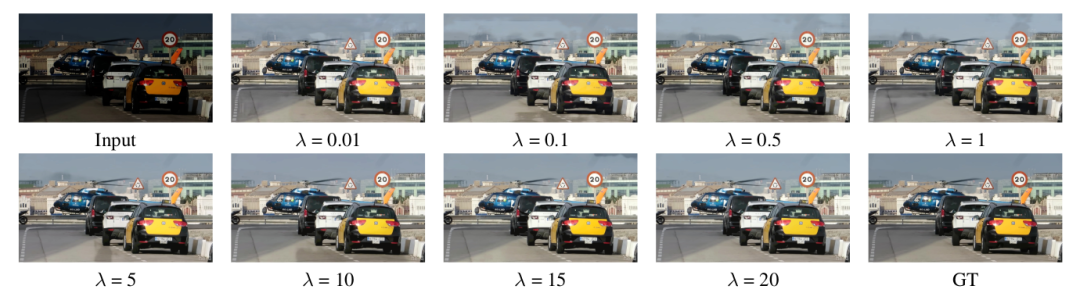

图4 不同权重的视觉效果。随着权重的增加,模型输出变得更加平滑。

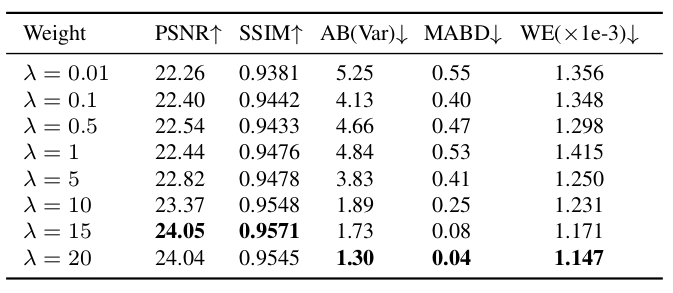

表1 分支重量的消融研究。随着权值的增加,模型在时间上变得更加稳定,峰值信噪比和SSIM增加

图5 几个帧用于实际数据测试。自上而下:1。输入2.石灰[6];3.姆布伦[19];4.RetinexNet[30];;5.MBLLVEN[19];6.SMOID[9];7.SID[4];8.SFR[5];9.我们的结果。

点击阅读原文, 即可获取本文下载链接。

本文仅做学术分享,如有侵权,请联系删文。

3D视觉精品课程推荐:

1.面向自动驾驶领域的多传感器数据融合技术

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码) 3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进 4.国内首个面向工业级实战的点云处理课程 5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解 6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦 7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化 8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

9.从零搭建一套结构光3D重建系统[理论+源码+实践]

10.单目深度估计方法:算法梳理与代码实现

11.自动驾驶中的深度学习模型部署实战

12.相机模型与标定(单目+双目+鱼眼)

13.重磅!四旋翼飞行器:算法与实战

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近4000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~