点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

作者丨paopaoslam

来源丨 泡泡机器人SLAM

原文链接: https://fujie.ece.ufl.edu/wp-content/uploads/sites/79/2022/02/SemanticSLAM-Covisibility-RAL2022.pdf

标题:Towards Accurate Loop Closure Detection in Semantic SLAM With 3D Semantic Covisibility Graphs

作者:Zhentian Qian, Jie Fu, Jing Xiao

机构:Worcester Polytechnic Institute

来源:RAL 2022

编译:zhuhu

审核:介来拉石

摘要回环对于在未知场景中纠正SLAM中的累计误差是必要的。然而,传统的回环方法是基于low-level的几何信息或者图片特征点,这可能产生导致严重的歧义从而不能区分相似的场景,因此会导致错误的环路闭合出现。虽然在一些论文中已经考虑了使用2D语义图像信息来检测环路闭合,但将三维场景作为语义SLAM的一个组成部分进行比较的工作却很少。本文介绍了一种叫做SmSLAM+LCD的方法,将结合high-level的3D语义信息和low-level的特征点信息整合到语义SLAM中,用来实现准确的回环检测和有效的减小漂移误差。我们所提出方法中测试中展示了方法的有效性。

主要工作与贡献语义SLAM专注于3D物体的表示,建图和定位。

在本文中,我们提出了一种新的基于单目视觉的语义SLAM系统中的循环检测和漂移校正方法,以充分利用high-level的语义信息和low-level的几何信息。我们称为:SmSLAM+LCD(Semantic SLAM+Loop Closure Detection)

-

一种新颖的将语义对象信息整合到3D的语义共视图中

-

一种分层的环路检测方法,首先基于low-level的几何特征提出的环路候选,之后通过比较对应的3D语义共视图来避免FP(False Positives)的情况

-

一种从粗到精的方法来计算环路闭合的SIM(3)的变换

-

一个仿真数据集和真实场景数据集用来检测环路检测是否产生了FP的情况

-

测试结果证明了引入的SmSLAM+LCD方法的有效性

作者根据上一篇文章的语义SLAM进行了整合。从单目相机的输入中进行语义物体的检测和追踪。从ORB-SLAM2的追踪模块提供视觉里程计的内容。此外,基于Yolov3的检测模块用于检测图像中的对象。在有检测到对象的ROI中提取ORB特征点并用BoW对检测到的对象进行表示。最后一步是执行对象级数据关联,将检测到的对象和地图对象进行匹配。

语义建图模块是通过语义对象检测和追踪所产生的新的关键帧实现的。当新的关键帧加入后,我们会更新这个关键帧以及地图对象和语义关键帧的数据。

来自每个图像关键帧所构建的语义对象会进一步构建到对象的共识图中,该共视图也是基于新的观察进行更新。

当建图模块处理结束关键帧之后,语义回环检测模块会比较该关键帧和其他存储在地图数据库里面的关键帧,用来检测回环。

对象共视图 图的定义一个对象的共视图在地图中进行维护,用来提供结构化的环境表示。

-

顶点V:共视图的顶点时语义SLAM算法构建的3D语义地标,即地图数据库中的地图对象。每个构建的对象宇对象类标签的概率分布相关联,用来表示感知的不确定性,此外,“地图对象”和“语义地标”将在本文中互换使用,每个地图对象包含以下信息:

-

椭球体的主轴长度,可以包围住地图对象,用表示,表示主轴

-

地图对象的中心

-

表示对象类别的集合,表示在类别上的概率分布集合,顶点存储了对象类的概率分布, 给定一个对象类别,则该顶点是类别的概率为.

-

共享地图对象观测的特征点集合

-

在关键帧上包含地图对象的区域,所计算得到的词袋向量集合

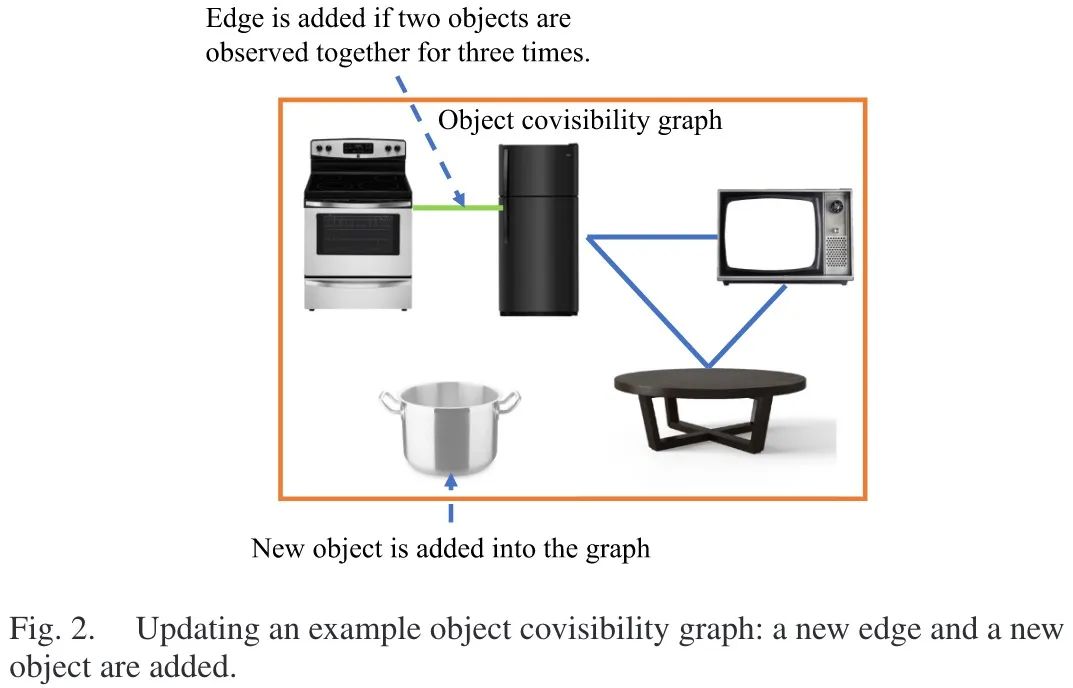

边Edges:只要在同一个语义关键帧中观察到与两个顶点相关联的地图对象至少三次时,就会在两个顶点之间添加一条边

图的构造和维护如图2所示,当一个新的语义关键帧添加后,对象共视图将会更新。

首先,更新共视图的地图对象。如果在语义关键帧中观察到新的对象,则新的对象不包含在共视图中,例如图2的锅,则将其添加到顶点集合中。其次,更新共视图的边,如果在同一个语义关键帧中观察到任意一对地图对象三次,如图2中的冰箱和洗衣机,则在其中添加一条边。

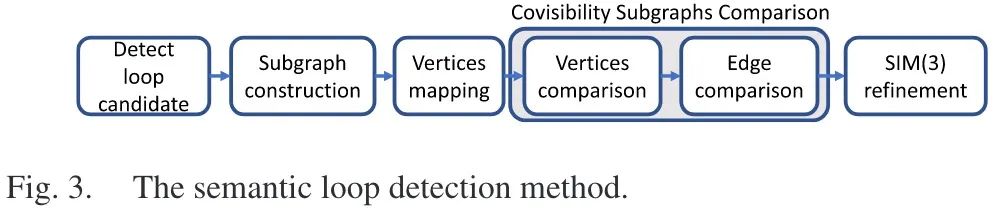

语义回环检测如图3所示。

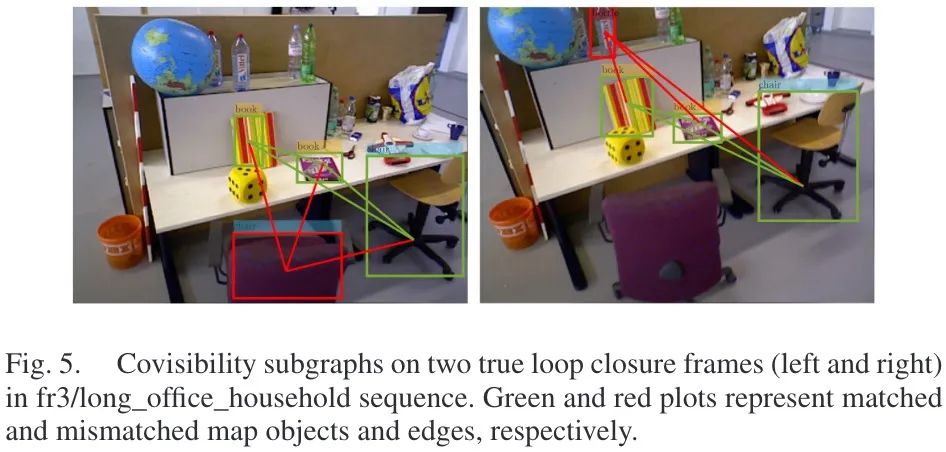

本文中,我们介绍了SmSLAM+LCD,一个很好的继承到我们先前的语义SLAM系统中的语义闭环方法。我们的方法利用来自SLAM系统的高层语义和低层几何信息来进行环路检测和漂移校正。具体地说,SmSLAM+LCD在映射的3D语义对象上构建对象共视图,并不断地用最新观测更新它。在执行环路检测时,该方法通过比较与环路候选帧相关联的对象共视子图来检查基于低层几何特征的环路候选。为了纠正累积的漂移,我们的方法包括一种从粗到精的方法来计算环闭合帧之间的变换.

我们使用TUM RGB-D数据集以及我们自己的虚拟和真实数据集测试了SmSLAM+LCD。实验结果表明,与ORB-SLAM2和ORB-SLAM3相比,SmSLAM+LCD能够在检测到环路闭合后实现更准确的漂移校正,并区分相似场景,避免了ORB-SLAM2和ORBSLAM3报告的误报环路闭合。

在本文中,我们假设每个对象对真环路闭合的检测或对假环路闭合的拒绝都有同等的贡献。可以对其进行修改,以不同的方式处理静态对象和移动对象,这是我们下一步计划做的。我们还将研究在共视图中使用权重来改进动态环境中的环路检测。

参考文献-

Zhentian Qian, Kartik Patath, Jie Fu, and Jing Xiao, "Semantic slam with autonomous object-level data association’’, In 2021 IEEE International Conference on Robotics and Automation (ICRA), 2021, [PDF].

本文仅做学术分享,如有侵权,请联系删文。

3D视觉工坊精品课程官网:3dcver.com

1.面向自动驾驶领域的多传感器数据融合技术

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码) 3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进 4.国内首个面向工业级实战的点云处理课程 5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解 6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦 7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化 8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

9.从零搭建一套结构光3D重建系统[理论+源码+实践]

10.单目深度估计方法:算法梳理与代码实现

11.自动驾驶中的深度学习模型部署实战

12.相机模型与标定(单目+双目+鱼眼)

13.重磅!四旋翼飞行器:算法与实战

14.ROS2从入门到精通:理论与实战

15.国内首个3D缺陷检测教程:理论、源码与实战

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近4000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~